天文用CMOSカメラはどんどん新機種が出てきて面白い状況ですが、「カタログスペックをどう読み解いたらいいか」については明快な答えが自分の中にもありませんでした。

お恥ずかしながら正直なところ、「ゲイン」「フルウェル」「リードノイズ」「ダイナミックレンジ」だとかのグラフを眺めていても、どのカメラが良いのか、どういう条件で使うのが良いのか、判断や指針に迷っていたのが実態です。

ベテランの方々にとっては既に常識の範疇とは思いますが、あくまでも個人的な備忘録としてゆるく整理してみました。

※ 「ダイナミックレンジ」の考察と記載に誤りがあったため、改訂・補記しました 2023.8.17

※※ 画素数やセンササイズとの関係についての補足追記と、一部の誤表記の修正を行いました。 2024.6.9

|

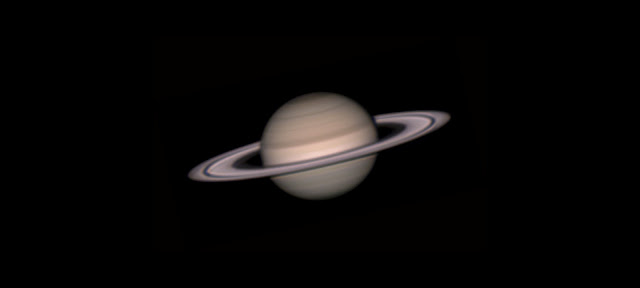

| 新調したカメラで撮ってみた土星…あんまり条件を考えずにやってしまいました 2023.8.5 22:30-22:42 JST C11 + Powermate 4x + ADC + MARS-CII Exp.15ms, Gain600, capture 1452x824, stacked 27% of 45,000frames |

【結論】ダイナミックレンジしか勝たん

カメラ選びの観点は感度?ノイズ?色々ありそうに思えますが、究極的な結論は「ダイナミックレンジ」です。カメラの偉さは、画素数やセンササイズもありますが、ダイナミックレンジで決まってしまいます。

ダイナミックレンジを同じ感度(※ゲイン値ではありません)で比較して、大きい方が勝ちです。「ADコンバータのビット幅が大きく、ノイズが小さいのが良いカメラ」とも言いかえられます。

ダイナミックレンジの単位は「ビット」で、1枚の画像が持っている階調を示しており、1ビット違うと2倍、2ビット違うと4倍の差があります。(2023.8.17補記)

【追補】センササイズ・画素サイズ・画素数が大きいことの意味

カメラの性能は、真っ先に画素数やセンササイズ、および画素サイズで語られることがしばしばあります。用途によってそれぞれに意味があるので一概に「性能」とするのが良いのかどうかは議論が残りますが、カメラが記録する情報量という観点では、次の式に集約されます。

情報量=2^(ダイナミックレンジ)×画素数

「2^(ダイナミックレンジ)」というのは、ノイズレベルを除いて輝度を表現する総階調を表しています。

つまるところ、同じダイナミックレンジだったら画素数が大きいほうが情報量が多いということになります。また、同じ画素数と画素の特性であれば、大きい画素の方、つまり大きいセンサが有利です。

例えば、同じ画素数のフルサイズカメラとAPS-Cであれば、同じ画角になるレンズとF値を選んだとしてもフルサイズの方が多くの光量を得られます。結果としてゲインを落として撮影できるなどの効果をえられるで、「良い画質」を得ることに繋がっていくものと考えられます。(2024.6.9補記)

詳細は下記を御覧ください。

CMOSカメラのカタログに出てくる「ゲイン」やグラフの横軸の数値は、いわゆる「感度」を設定するための数値です。「感度」は光子1個に相当するデジタル変換後の数値で、「ゲイン」はこれを設定・調整するための値というわけです。

カメラの内部的には、ADコンバータに入力する前の段階のアンプのゲインがアナログ的に調整されています。

カタログのグラフの横軸は、撮影時に設定するいわゆるゲイン値です。しかし、ゲイン値と変換レートの関係はリニアではなく指数関数的です。ゲインを少し動かすと感度がググっと上がった感じになるのはこのためです。

|

| Gain=0設定でのR0の値 (主要なCMOSセンサ) |

その逆数がリニアな「感度」に相当する値になるのですが、これを感度R とおくと、概ね次のような関係になっていて、ゲイン値が60上がると感度は2倍になる関係があります(※ZWOやPlayerOne社のカメラの場合。QHY社のカメラは異なる関係になっているようです。)。

感度R = R0 × 2^(Gain/60)

AD変換後の画素値 = 電荷数 × 感度R

なお、ゲイン0の時の感度R0はカメラによってまちまちで、そのカメラがどの程度の低感度域に対応しているかを示しています(※カメラの感度の良否を表しているわけではありません)。

■「フルウェル」はセンサの優劣を示さない

フルウェル容量は、飽和に達するのに要する電荷の数で、単位が個数[e-]になっています。しかし実はこの「フルウェル容量」はゲインとビット幅で下記のように計算できる値で、グラフはゲイン設定時の参考でしかなく、センサの優劣を表してはいません。センサの優劣はADのビット幅の違いだけです。

(※16bit ADCのカメラでは、低ゲイン時にセンサ自体の「最大フルウェル」が下記式によらずに現れることがあるようです。これは素子そのものの性能と考えられます。(2023.8.20追記)

フルウェル容量=総階調 ÷ 変換レートC

=感度R × 2^(ビット幅n)

総階調はA/Dコンバータのビット幅を n とすると 2^n で表される数値で、 8bit A/D なら 256、10bit なら1024、12bit なら 4096、14bit なら 16384 です。変換レートCはゲインのグラフに出ている"Conversion Rate"や"System Gain"と称する値で、感度Rの逆数です。

式から明らかなように、ここにセンサの性能が入り込む余地はなく、単純にゲインと裏表の数値となっています。フルウェル容量は、同じビット幅のA/Dで同じ感度R設定にするとどのカメラでもビタ一文変わらないのです。

|

| 惑星をこれで狙ってます (つい中古鏡筒を入手してしまいました) |

宣伝には「大きなフルウェル」などと謳われていたりしますが、これは「設定可能な最低感度が低い」ことしか意味しておらず、要するにGain0の時の感度(前出の式のR0)が変わっているだけです。月面など、大変明るい対象を撮影する場合には意味がないとも言えませんが、通常はシャッター速度で調整すればよいもののようにも思えます。

但し、フルウェル容量は撮影時の参考値としては意味を持ちます。フルウェル容量で階調が決まるからです。「フルウェル容量」とは飽和に要する電荷の個数のことなので、原理上この個数より細かい階調では撮影出来ていません。電荷1個が概ね光子1個に相当するわけですから。

ゲインを上げると短いシャッターを切れるようになりますが、カタログのグラフの通りフルウェル容量は減っていき、階調が制限されるわけです。ビット幅の大きいADCを使っていても高ゲインでザラザラしてくるのは、ノイズがゲインアップして見えてくるのと同時に電荷の個数カウント以上の階調が現れず、S/N比が下がるためです。ADCのビット幅は量子化誤差の低減には役立ちますが、暗い対象に対してはゲインを上げてもそれだけでは階調を稼ぐ効果はないのです。

このように、階調を決めるのはADコンバータのビット幅だけではなくフルウェル容量なのですが、フルウェルは個々のカメラの性能で変わるわけもなく、感度と表裏の数字でしかありません。強いてカメラ同士の比較を言うならば、ADコンバータのビット幅の違いが差として現れます。大きいフルウェルを高い感度で得ようとすると、ビット幅がものを言う、とも言えます。

カタログにあるフルウェルのグラフは、「設定したゲインでどのくらいの階調で撮影できるのかを示した線図」ということになります。

■「リードノイズ」はこう読む

このグラフは縦軸にAD変換の読み取り時に生じるノイズの平均値を電荷量(e-)で示したものになっていますが、これもどう読んだらいいのか迷わせるグラフです。

実際問題としては、被写体がもたらす電荷とリードノイズ(e-)との差の大小が撮れる画像の有効階調を決めるということと、ゲインに対して右肩下がりのリードノイズの曲線を見ると、撮ってる被写体がサチらない範囲で目一杯ゲインを上げて撮るのが吉という見方になります。

一方で、リードノイズの数値はセンサの性能が現れるところですから、カメラの優劣を決める指標にはなります。但し、比較は同じ感度(システムゲイン/変換レート)の設定ゲインで行う必要があります。

|

| リードノイズの比較の仕方 - 同じシステムゲインでの値で比較します 図はPlayerOne社webページからの引用 |

図は、IMX662とIMX533の比較例ですが、例えばシステムゲインが両者同じ0.034 [e-/ADU] となるGain設定値で比較すると、IMX662の 0.736 [e-] に対して IMX533 では1.064 [e-] となっており、世代が新しい SONY のSTARVIS2センサーの IMX662の方がノイズが少ないということが分かります。同様にIMX290を調べてみるとIMX533に近い値を示しており、新世代チップの方が優れているということが分かります。

このように、リードノイズのグラフからセンサの優劣を見ることは可能です。

因みに、リードノイズ[e-]をわかりやすい数値にしようとすると、感度Rを掛けてAD変換後の数値にすると少し見えてきます。カタログ数値でいうと、変換レート(コンバージョンファクター/システムゲイン)で割るということと同じで、全体の階調の中でどのくらいがノイズになるかを目安として読み取れます。

ダイナミックレンジDRの定義は「輝度最大値をリードアウトノイズの値[ADU]で割って底2の対数を取ったもの」ですが、これは前出の式からすると「フルウェル容量をリードアウトノイズ[e-]で割って底2の対数を取ったもの」と等価です。

すなわち、値はノイズで揺らいでいるので、そのゆらぎの平均幅を1単位として、最大輝度をその何個分で表せているか、という値ということになります。

基本的には ADコンバータのビット幅による総階調(最大輝度)が分子なのでこれが大きい方が良く、分母のノイズが小さい方が良いということになります。

カメラの優劣は、このダイナミックレンジで決まるということです。カメラ同士の比較の際には、リードノイズのときと同様に、同じ感度(システムゲイン/コンバージョンレート)で比較します。

また、同様の考え方で撮れた画像にどれだけ多くの情報を含んでいるか、というのを測ることもできます。分子をその被写体の最大輝度値に変え、分母をリードノイズの値[ADU]で割って対数をとれば良く、これが大きいほど「質の高い画像」が撮れていると言えます。

したがって、画像のダイナミックレンジを最大化するようにゲインを設定するのが吉だということになります。

例えばDRが8と言われれば、概ね8bit程度の階調情報しか得られないことを意味していて、12と言われれば 12bit ADCの能力をいかんなく発揮できている状態、という程度な読み方です。1bitの差が階調で2倍の違いを生む、ということです。

因みに、撮影する「画像のダイナミックレンジ」すなわちS/N比を最大化するには、極力ゲインを上げて被写体の最大輝度値を(飽和しない範囲で)大きくとるのが良い、ということになります。

※この章は、当初「ダイナミックレンジに大した意味なし」としておりましたが、誤りでありました。全面的に改訂しました。 (2023.8.17)

____

さて、CMOSセンサー選びも、私のような初心者にはなかなか難しいものがあります。ただ、整理してみて分かったのは、「売ってる人たちも大して分からずに宣伝してるな、これは」ということでありました。

いち消費者としては、様々な情報の中から真贋を見極めながら製品を選びたいと思いますし、使う際にも公開されている情報を上手くつかって効率よい方法を見出していきたいところです。

コメント

またaz-gtiのツボ助かります!!

ただどうしてもたまに高度制限も完全無視で突然真上どころがそのままバックドロップ状態まで真後ろに向いてしまう症状がでてしまいます。

じぶんのは短い鏡筒なので大丈夫ですが本来制限必要なものだとぶつかってしまいますね。。

なぜ突然そうなるのか、高度制限ブッチぎりでバックドロップするのか不明です。。

位置情報を再度更新して、その時になってるような謎です。。

AZ-GTi の高度制限無視がなぜ起こってしまうのかは、ちょっと謎ですね。

スマホのSynScanアプリでのタイムゾーンや観測値の位置情報はスマホからの情報を参照しているとは思うのですが、その位置情報が狂ってしまうとおかしくなる可能性は否定できないですね。

私も出くわしたことがない現象なので何とも分からないのですが、少なくとも架台側ではなくアプリ側の問題だろうとは思います。

カメラの選定ではダイナミックレンジ、撮影時の条件出しではSN比が、気にすべきパラメータなのだと思います。